U 2025. godini izdvojilo se nekoliko trendova vezanih za razvoj i primenu alata i servisa zasnovanih na AI koji su imali direktan uticaj na proizvodnju medijskog sadržaja, društveno-političke procese širom sveta, pa i same osnove onoga što ljudsku svakodnevicu, rad, učenje, komunikaciju i odnose čini – ljudskim. Sumiranje tema, događaja i fenomena „iza ekrana“ ne samo što rezimira prošlu, već nagoveštava i ono što bi u 2026. godini moglo doći.

AI kao emocionalna infrastruktura

U 2025. godini, AI je za značajan deo korisnika prestala da bude samo „alat“ integrišući se u svakodnevicu ne samo kroz procese rada ili komunikacije, već direktno u najosetljivije segmente života, kao što su emotivni odnosi, mentalno zdravlje, problemi poput usamljenosti ili različitih oblika zavisnosti. Veštačka inteligencija nije više vezana samo za produktivnost i „pametnu pomoć“, već je sve češće postajala deo ljudske emocionalne infrastruktura: digitalni saputnik, uteha, navika, pa i zamena za socijalne odnose.

To se moglo videti kroz priče o adolescentima koji biraju AI aplikacije umesto prijatelja, jačanje tržišta digitalnih emocija i različitih oblika „pretplatničke intimnosti“, kao i kroz upozorenja na mentalne posledice intenzivnog vezivanja za četbotove i operisanje pojmovima poput AI psihoze u analitičkim tekstovima. Protekla godina je pokazala da se publika se sve češće ne samo „informiše“ ili „zabavlja“, već i emocionalno reguliše – umiruje, motiviše, ubeđuje – upotrebom AI.

Rat za pažnju: Sofisticirana manipulacija i predaja algoritmu

Rat za pažnju postao je sofisticiraniji i, ponovo, veštačka inteligencija je imala važnu ulogu u upravljanju publikom onlajn – od rage-bait logike kao alata direktnog uticaja na političku ili ideološku vidljivost, do potune „predaje“ algoritmu kao naznakom spremnosti da se odustane i od ono malo izbora koji je preostao onlajn zarad jednostavnosti i udobnosti.

Time su stvoreni još čvršći temelji za manipulaciju i dezinformisanje onlajn – da li će biti iskorišćeni, saznaćemo verovatno vrlo brzo. Prostor za optimizam se smanjuje u svetlu još jednog trenda iz prošle godine – dezinformacije evoluiraju kao deo strategija propagande 2.0 i hibridnih informativnih ratova. Tema propagande i „digitalnih frontova“ je bila eksplicitno prisutna od strateški plasiranih kampanja malinformisanja do bot napada ili koordinisanih akcija ugrožavanja bezbednosti i reputacije onlajn, pa se o 2025. godini može govoriti i kao godini u kojoj smo imali snažno izražene motive algoritamskih bitaka.

Veštačka inteligencija nije više vezana samo za produktivnost i „pametnu pomoć“, već je sve češće postajala deo ljudske emocionalne infrastruktura: digitalni saputnik, uteha, navika, pa i zamena za socijalne odnose

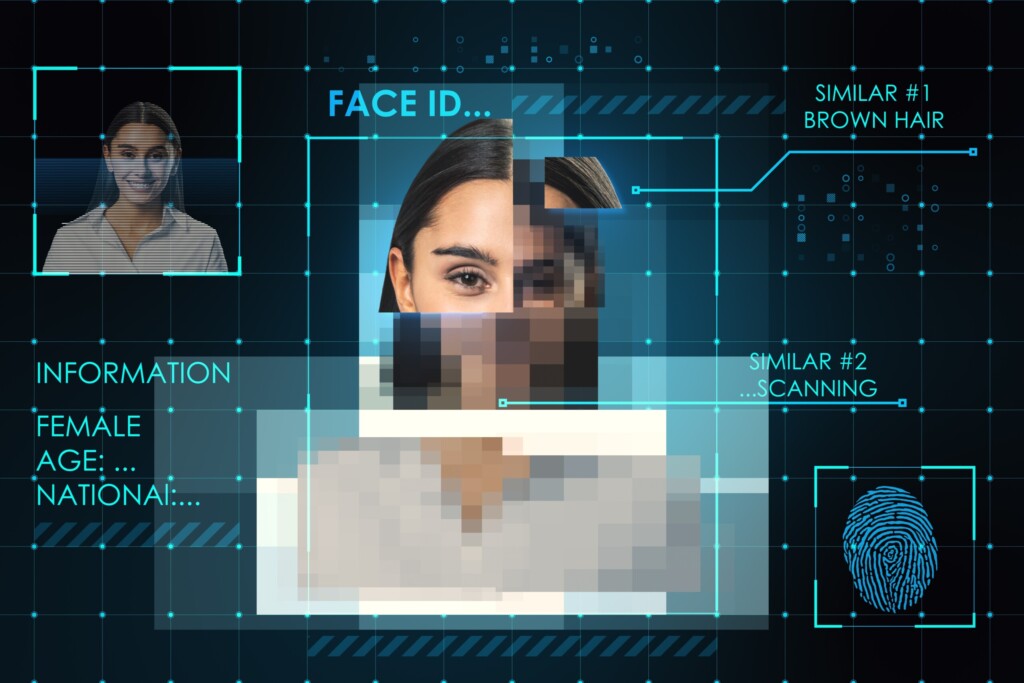

Tako se i težište kritičkog promišljanja pomerilo sa pitanja „da li je nešto lažno“ ka pitanju „ko usmerava tokove pažnje, emocija i poverenja“. Zato je i dominantni narativ u prošloj godini manje bio vezan za pojam „lažna vest“, a više za industrijalizovanu operaciju uticaja. Identitet, lik i glas korisnika postali su vredniji, pa samim tim i zaštićeniji na nekim tržištima. Deepfake je počeo da ulazi u fazu prava i regulacije, a jedna od najjasnijih naznaka je činjenica da je digitalni identitet postao pravna tema mnogo detaljnije nego do sada. Izašli smo iz početne faze iznenađenosti i šoka da naši privatni podaci mogu biti otuđeni, i sada koračamo ka fazi u kojoj zahtevamo da znamo ko poseduje naša lica i glasove – i ko plaća štetu, ukoliko su zloupotrebljeni onlajn.

Digitalni identitet kao bojno polje

Pitanja vezana za podatke i privatnost bila su prisutna u stručnim i akademskim debatama, uz sve snažniju svest o tome da je publika za tech gigante sirovina, a da čak i najintimniji sadržaji (koje, doduše, korisnici često dele svojevoljno i sa radošću) služe kao dataset. Motiv monetizacije privatnosti (uključujući fotografije dece i vrednost ličnih sadržaja) i šire priče o tome da lični podaci postaju tuđi profit pokazuju da se privatnost mora tretirati kao jedno od centralnih političko-ekonomskih pitanja. Kao nikada pre, 2025. godina je u javnu diskusiju uvela problem tretiranja svakodnevnog života kao sirovine za AI modele i targetiranje korisnika.

Digitalni alati i servisi zasnovani na veštačkoj inteligenciji menjali su i tradicionalne medijske modele proizvodnje sadržaja, ali i uloge medija u savremenim društvima. Započet je snažan pokret stvaranja novih autoriteta u oblasti informisanja i zabave, što je otvorilo pitanje pozicija i snaga news redakcija u odnosu na pojedinačne kreatore sadržaja onlajn i „nova lica“.

Motiv monetizacije privatnosti (uključujući fotografije dece i vrednost ličnih sadržaja) i šire priče o tome da lični podaci postaju tuđi profit pokazuju da se privatnost mora tretirati kao jedno od centralnih političko-ekonomskih pitanja

Pomeranje poverenja i autoriteta se videlo kroz temu news influensera kao konkurencije ili alternative zvaničnim redakcijama, ali i kroz širu priču o „arhitektama AI“ kao kulturnoj personifikaciji tehnologije. Navike publike i novi trendovi koje dominantno oblikuje generacija Z, ali i dolazeća Alpha, pokazuju da se informisanje sve više seli sa institucija na ličnosti i formate – što menja i politiku, i odgovornost, i standarde provere činjenica koje oblikuju posredovanu stvarnost.

AI i politika – od debate do optimizacije afekata

Uticaj veštačke inteligencije i digitalnih tehnologija na političke procese tokom 2025. godine postao je vidljiviji i direktniji nego ikada ranije. Politika je ređe funkcionisala kao prostor argumentacije, javne debate i sukoba ideja, a češće kao polje optimizacije afekata, precizno targetiranih poruka i algoritamski vođenih narativa. AI alati omogućili su političkim akterima da u realnom vremenu testiraju, prilagođavaju i distribuiraju poruke prema emocionalnim mapama različitih segmenata publike, čime se politička komunikacija dodatno udaljila od univerzalnih poruka i zajedničkog javnog prostora. Umesto jedne kampanje, nastaje bezbroj paralelnih verzija stvarnosti, prilagođenih strahovima, frustracijama, identitetskim obrascima ili očekivanjima različitih grupa.

Takav razvoj i dalja eskalacija mogu imati duboke posledice po društvene procese. Kada se političko delovanje oslanja na personalizovano ubeđivanje, granica između informisanja, manipulacije i emocionalnog usmeravanja postaje gotovo nevidljiva. Građani se sve ređe prepoznaju kao deo kolektiva koji deli minimalni skup činjenica i vrednosti, a sve češće kao izolovane ciljne grupe unutar algoritamski fragmentisanog javnog prostora.

AI alati omogućili su političkim akterima da u realnom vremenu testiraju, prilagođavaju i distribuiraju poruke prema emocionalnim mapama različitih segmenata publike, čime se politička komunikacija dodatno udaljila od univerzalnih poruka i zajedničkog javnog prostora

Time se dodatno slabi kapacitet društava da vode smislene javne rasprave, da artikulišu zajedničke interese i da grade poverenje u institucije. AI tada ne deluje samo kao tehnološki akcelerator, već kao politički katalizator koji ubrzava procese depolitizacije, polarizacije i erozije demokratskih mehanizama. Naravno, isti alati nose i potencijal za drugačije ishode. AI može doprineti većoj dostupnosti informacija, osnaživanju marginalizovanih glasova i boljoj organizaciji građanskih inicijativa, ali samo pod uslovom da se njena upotreba u političkom prostoru odvija uz jasna pravila, transparentnost i odgovornost. U suprotnom, rizik je da veštačka inteligencija postane nevidljivi posrednik političke moći – tehnologija koja ne donosi autoritarizam direktno, ali sistematski potkopava temelje demokratskog odlučivanja.

Slučaj Srbije: Laboratorija bez zaštite

Srbija, kao društvo sa dugotrajno narušenim poverenjem u institucije, fragmentisanim medijskim sistemom i visokim stepenom političke polarizacije ulazi u fazu intenzivne primene digitalnih tehnologija i AI alata bez jasnih pravila, transparentnih procedura i javne rasprave o njihovoj upotrebi. U takvom okruženju, algoritamski posredovana politička komunikacija ne deluje kao neutralni tehnološki napredak, već kao amplifikator postojećih disbalansa moći.

Kada se digitalni alati koriste u prostoru u kom su granice između vlasti, medija i platformi već zamagljene, rizik nije samo manipulacija informacijama, već dugoročno oblikovanje političkog ponašanja publike kroz navike, afekte i obrasce pasivne konzumacije sadržaja. Posebno zabrinjava činjenica da se digitalna pismenost, medijska odgovornost i regulacija AI tehnologija u domaćem kontekstu i dalje tretiraju kao sporedne teme, iako direktno utiču na kvalitet demokratskih procesa.

Srbija tako rizikuje da postane poligon na kom se globalni modeli digitalne političke manipulacije primenjuju bez otpora, ali i bez vidljivih mehanizama zaštite građana

U odsustvu sistemskih odgovora, prostor ostaje otvoren za eksperimentalnu primenu tehnologija koje mogu dodatno oslabiti javni dijalog, produbiti nepoverenje i normalizovati osećaj da su politički procesi nešto što se „dešava drugima“, negde iza ekrana. Srbija tako rizikuje da postane poligon na kom se globalni modeli digitalne političke manipulacije primenjuju bez otpora, ali i bez vidljivih mehanizama zaštite građana.

Godina pred nama – AI kao nevidljiva struktura savremenog društva i politike

Šta ova kretanja, promene i zaokreti nagoveštavaju i šta se može očekivati u 2026. godini? Neka od sledećih predviđanja su moguć, logičan nastavak.

Politika će sasvim izvesno nastaviti da prelazi u personalizovanu persuaziju onlajn, kroz kreiranje mikro-narativa za mikro-publike. Ako je 2025. naglasila afekat kao sredstvo osvajanja pažnje i, posledično, moći, 2026. će to spojiti sa personalizacijom. Iste političke poruke biće plasirane u desetinama verzija, prilagođene hiperfragmentisanim segmentima publike, po emocionalnim okidačima – bes, strah, otpor.

Ovakvi trendovi mogu stvoriti nove mogućnosti za mobilisanje građana onlajn oko javnog interesa ako postoje transparentnost i odgovornost. Nažalost, opasnosti su složenije i izvesnije – „tiha propaganda“ koja doprinosi tome da publika dobija različite realnosti i nestajanje zajedničkog terena koji omogućava dijalog.

Deepfake sadržaji prestaju da budu inovacija koja skandalizuje i postaju svakodnevni rizik koji postaje normalizovan. U 2026. problem neće biti samo „lažni snimak“, već masovna erozija mogućnosti da se dokaže istina van svake sumnje. Sumnja postaje integralni deo kreiranja stavova, što doprinosi osećaju nepoverenja i u istinite audiovizuelne snimke. Paralelno, morala bi da rastu i pravna zaštita identiteta, jačanje digitalnih prava kao što su pravo na sopstveni lik i glas i novi, složeniji alati verifikacije. Kontra tim trendovima, mogu se očekivati zlokobniji reputacioni ratovi, ucene i „dokaz“ kao roba koja ima tržišnu vrednost.

Može se očekivati rast AI ponude u oblasti partnerskih ili terapeutskih odnosa i hibridnih aplikacija. Pozitivan aspekt ovih trendova je dostupnija podrška ljudima koji nemaju resurse, pomoć u adresiranju psiholoških izazova i samoregulaciji. Negativni su stvaranje zavisnosti, izolacija i emocionalna eksploatacija u kojoj postoji paywall za osećanja bliskosti i razumevanja

AI emocije postaće mnogo veće, potentnije tržište – ne samo finansijski, već i sadržinski i kvalitativno. Usamljenost kao proizvod, rizici opsesivnih veza sa AI alatima i mentalni slomovi u sudaru ljudskosti i tehnologije postaju plodan teren za zloupotrebe. Može se očekivati rast AI ponude u oblasti partnerskih ili terapeutskih odnosa i hibridnih aplikacija. Pozitivan aspekt ovih trendova je dostupnija podrška ljudima koji nemaju resurse, pomoć u adresiranju psiholoških izazova i samoregulaciji. Negativni su stvaranje zavisnosti, izolacija i emocionalna eksploatacija u kojoj postoji paywall za osećanja bliskosti i razumevanja.

U 2026. godini suočićemo se i sa fenomenom koji prevazilazi puko širenje dezinformacija – erom veštačkog, sintetičkog interneta, kao sve realnijom verzijom kontroverzne teorije o Mrtvom Internetu. Granica između ljudskog prisustva i algoritamske simulacije postaće još tanja, nevidljivija, dok se već sada ogromna većina onlajn sadržaja generiše bez direktnog ljudskog učešća.

Više nije reč samo o „botovima“ koji „miniraju“ konstruktivnu diskusiju, već o zatvorenim petljama u kojima AI generiše sadržaj, drugi AI ga konzumira i analizira, a treći na osnovu toga donosi odluke. U takvom ekosistemu, autentični ljudski glas postaje manjinski, a digitalni prostor prestaje da bude ogledalo društva i postaje prostor u kome se algoritmi odražavaju jedni u drugima.

Paralelno sa digitalnom ekspanzijom, u 2026. godini postaće očigledno da je veštačka inteligencija teška industrija 21. veka. Pitanje održivosti AI modela seli se iz domena tehnologije u sam centar geopolitike i ekološke etike. Ogromna potrošnja električne energije potrebna za održavanje serverskih farmi i milioni litara vode za njihovo hlađenje više se ne mogu tretirati kao „nevidljivi trošak“. Digitalna ekologija postaće prioritetno političko pitanje – društva će morati da biraju između tehnološke dominacije i resursne održivosti. Borba za resurse – struju i vodu – definisaće nove granice moći, a digitalna transformacija će se po prvi put suočiti sa svojim fizičkim i planetarnim limitima.

Digitalna ekologija postaće prioritetno političko pitanje – društva će morati da biraju između tehnološke dominacije i resursne održivosti

Dok se uticaj na mentalno zdravlje već mapira kroz usamljenost i zavisnost, 2026. godina doneće i prve jasne pokazatelje kognitivne atrofije. Masovno oslanjanje na AI asistente u obrazovanju i radu dovodi do procesa kognitivnog outsourcinga, delegiranja procesa razmišljanja i rešavanja problema mašinama. Iako personalizovano obrazovanje vođeno veštačkom inteligencijom nudi efikasnost, ono nosi i rizik slabljenja sposobnosti za duboko, kritičko i apstraktno razmišljanje.

Kada svaka prepreka u učenju postane rešiva jednim klikom, gubi se dragoceni prostor intelektualnog otpora koji je neophodan za razvoj autentične inteligencije. Umesto da širi ljudske kapacitete, AI može postati kognitivna proteza koja, dugoročno, čini ljudsku misao plitkom, a sposobnost samostalnog donošenja složenih zaključaka krhkom. Pitanje više neće biti šta AI može da uradi za nas, već šta mi prestajemo da budemo sposobni da uradimo bez nje.

Svi ovi procesi sugerišu da će 2026. godina verovatno biti trenutak u kojem će društva morati jasnije da artikulišu šta žele od tehnologije – i šta nisu spremna da joj prepuste. Najveće opasnosti više ne leže samo u sferi spoljne manipulacije ili dezinformacija, već u unutrašnjoj transformaciji korisnika: u eroziji zajedničke stvarnosti pod naletom hiperpersonalizovanih narativa, u emocionalnoj eksploataciji koja usamljenost pretvara u profit i u kognitivnoj atrofiji koja nas čini zavisnim od algoritamskih pomagala. U svetu sintetičkog interneta i ekonomije pažnje, privatnost prestaje da bude samo pitanje podataka i postaje pitanje prava na autentično, ljudsko iskustvo koje nije tretirano kao „gorivo“ za platformski kapitalizam.

Ipak, 2026. nosi i moguću klicu otpora. Kako AI bude postajala sveprisutna, ali i resursno skuplja, snažiće svest o potrebi za digitalnom ekologijom i novim standardima digitalnih prava koji štite naš lik, glas, osećanja i pažnju. Budućnost medija i javnog prostora zavisiće od toga da li ćemo uspeti da izgradimo institucije poverenja koje mogu da pariraju performansima algoritama.

Odgovornost za to da li će AI biti katalizator demokratskog osnaživanja ili alat sistemskog potkopavanja razuma ostaje na nama – u našoj spremnosti da zahtevamo transparentnost, postavimo etičke granice i, pre svega, odbijemo da budemo samo sirovina u tuđoj operaciji uticaja

Izazov koji stoji „iza ekrana“ više nije samo kako da razumemo mašinu, već kako da sačuvamo sposobnost kritičkog mišljenja i ljudske empatije u svetu koji je sve više dizajniran da nas u tome odmeni. Odgovornost za to da li će AI biti katalizator demokratskog osnaživanja ili alat sistemskog potkopavanja razuma ostaje na nama – u našoj spremnosti da zahtevamo transparentnost, postavimo etičke granice i, pre svega, odbijemo da budemo samo sirovina u tuđoj operaciji uticaja.